Google Cloud-da LLM-lərin incə tənzimlənməsi: müəssisələr üçün yeni mərhələ

Google Cloud LLM-lərin incə tənzimlənməsi üçün infrastruktur, alətlər və hazır çərçivələrlə müəssisələrin süni zəka boşluğunu aradan qaldırdığını açıqlayıb.

Google Cloud-da LLM-lərin incə tənzimlənməsi müəssisələr üçün yeni imkanlar açır

2 dekabr 2025 üçün hazırlanan bu xəbərə görə, «Startuphub» yazırdı ki, Google-un baş tərtibatçı nümayəndələri Ayo Adedeji və Mofi Rahman böyük dil modellərinin müəssisələrdə tətbiqi zamanı yaranan “boşluq” barədə danışmışdılar.

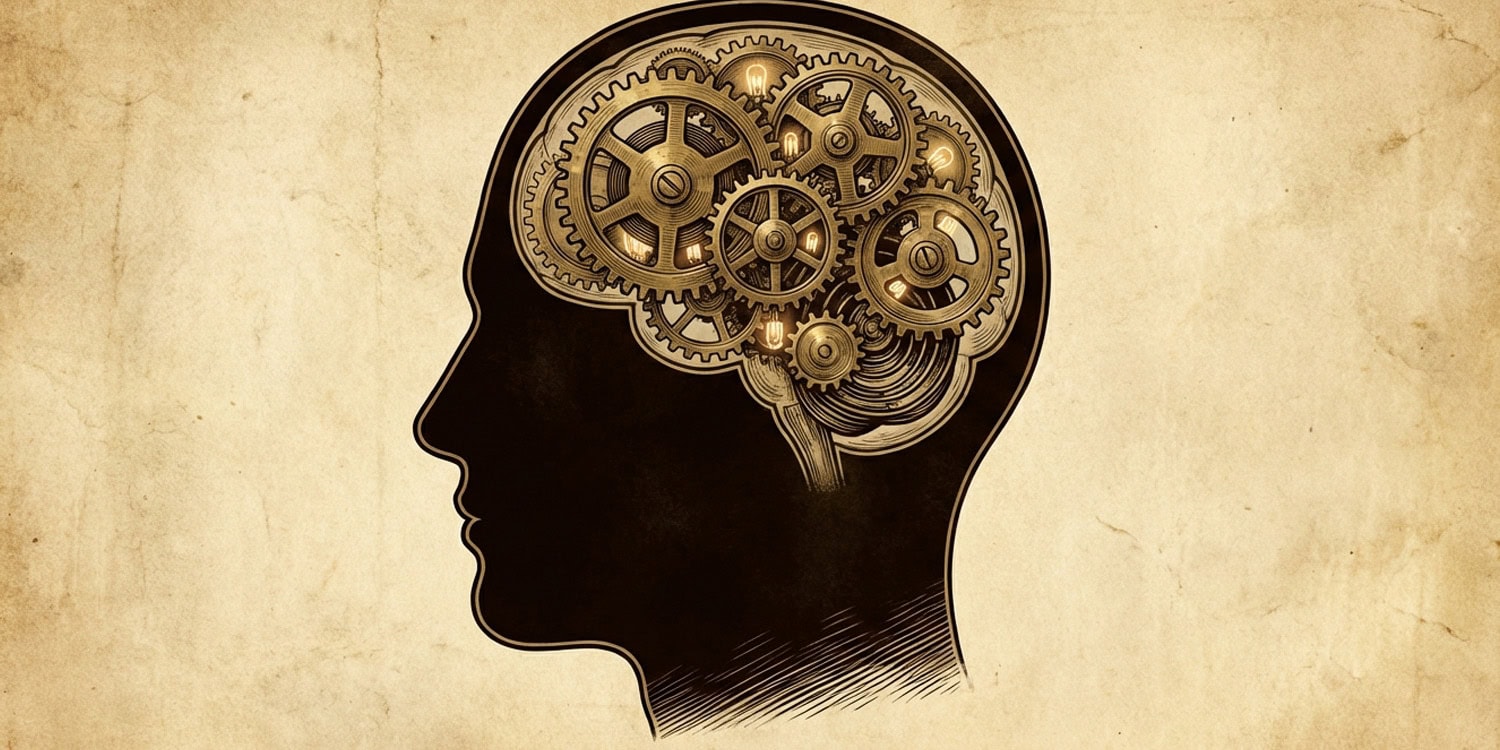

Onlar qeyd ediblər ki, güclü LLM-lər geniş internet məlumatı üzərində qurulsa da, çox vaxt xüsusi sahə biliyindən məhrum olur. Prompt yazmaq müəyyən qədər kömək etsə də, bu, modelin mövcud bilikləri ilə məhdudlaşır. Bir sözlə, biznes üçün dəqiqlik tələb edən işlərdə cavablar çox ümumi qalır.

Son Xəbərlər

Xiaomi 15 Ultra Qlobal Versiyası

Xiaomi yeni flaqman modeli Xiaomi 15 Ultra-nı qlobal satışa çıxaracağını təsdiqlədi. HyperOS 2.0 ilə yeni dövr başlayır!

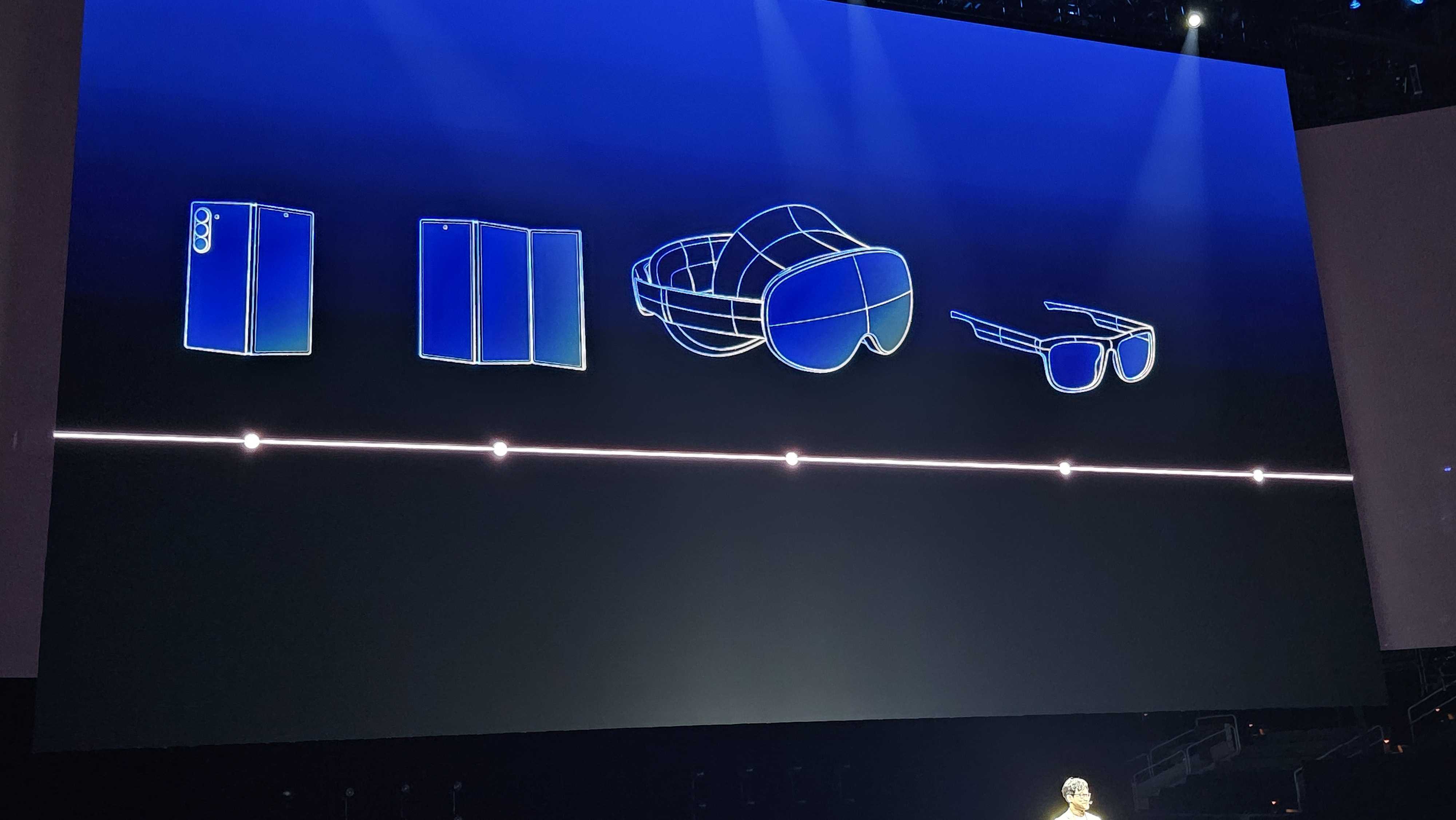

Samsung-un Üçqatlanan Telefonu

Samsung, Galaxy Unpacked tədbirində üçqatlanan telefon konseptini təqdim etdi. Yeniliklər haqqında daha çox məlumat əldə edin.

Realme GT 7: Ən Ucuz Smartfon

Snapdragon 8 Elite çipi ilə Realme GT 7 fevral ayında təqdim ediləcək. Yeni xüsusiyyətlər və uyğun qiymət gözləyir.

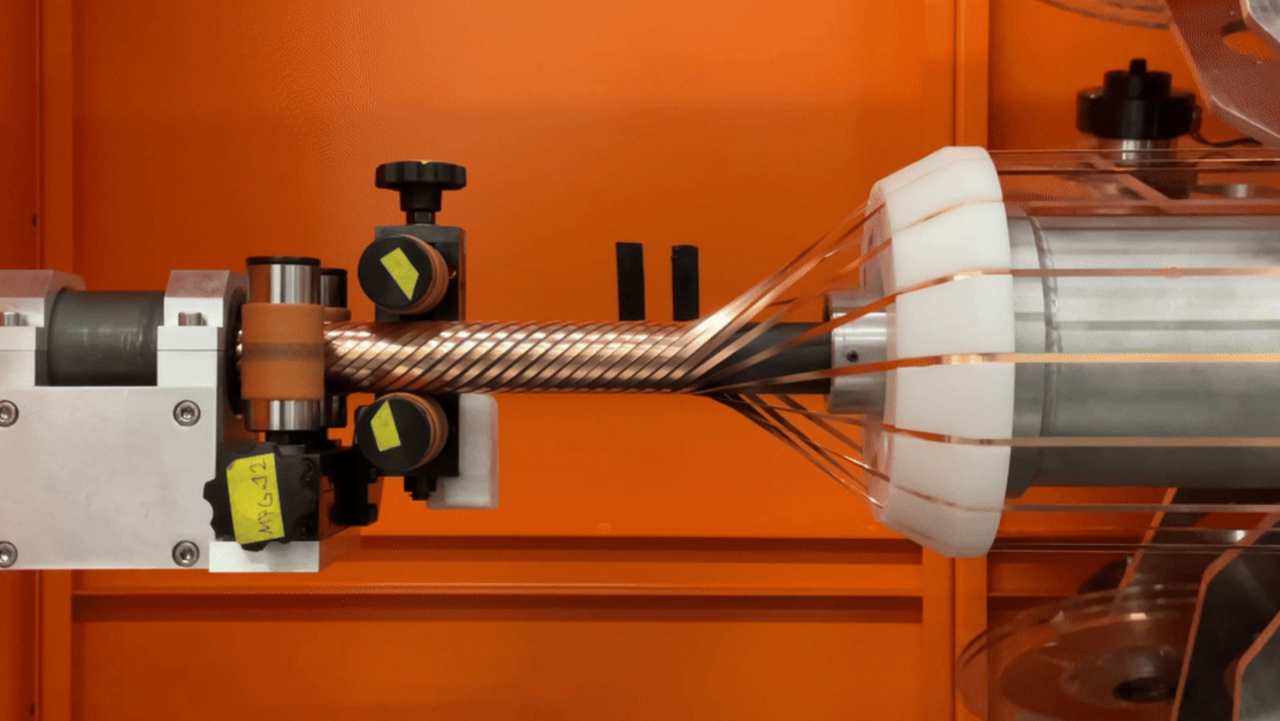

Bu səbəbdən incə tənzimləmə həyati əhəmiyyət kəsb edir. Adedeji bildirib ki, incə tənzimləmə modeli şirkətin öz sahəsinə uyğunlaşdırır, daxili terminləri və kontekstləri öyrədir. Gemma, Llama və Mistral kimi modellər biznes məlumatları ilə yenidən öyrədildikdə sahəyə uyğunluq bəzən onqat artır.

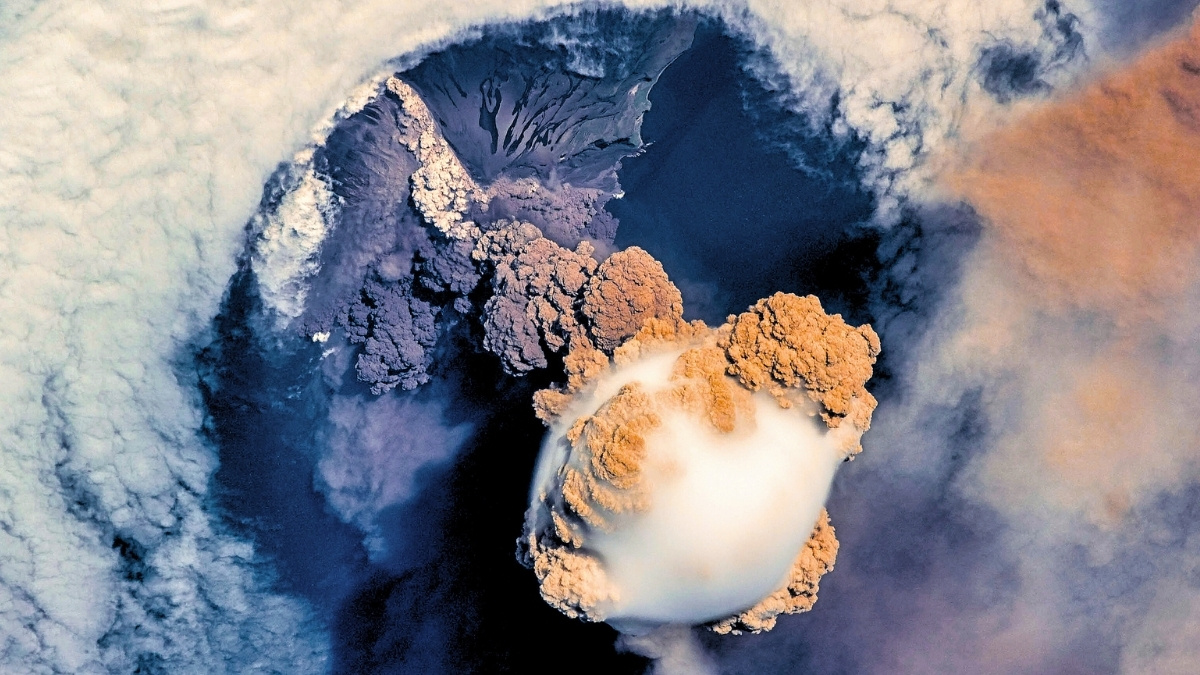

Ekspertlər vurğulayıblar ki, gələcək açıq şəkildə multimodal olacaq. 2027-yə qədər istehsal mühitində multimodal modellərin payının 1 faizdən 40 faizə yüksələcəyi proqnozlaşdırılır. Lakin belə modellər 4-8 dəfə daha çox resurs tələb edir və bu da müəssisələrin tətbiq prosesini çətinləşdirir.

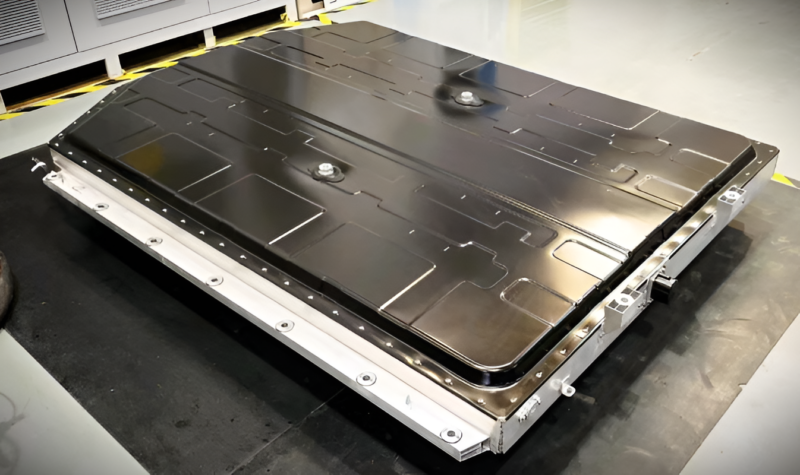

Google Cloud-un fikrincə, şirkətlərin qarşılaşdığı əsas maneələr üçdür: infrastrukturun mürəkkəbliyi, məlumat hazırlığının çətinliyi və təlim prosesinin idarə edilməsi. GPU və TPU kimi sürətləndiricilərə çıxış, multimodal məlumat cütlərinin düzgün qurulması, təlimin paylanması və fasilələrə davamlılıq - bunların hamısı əlavə yük yaradır.

Google Cloud özünü bu problemlərə cavab kimi təqdim edir. Şirkət müəssisə səviyyəli GPU/TPU infrastrukturunu, Vertex AI Training, Google Cloud Batch və GKE Autopilot kimi idarə olunan xidmətləri təklif edir. Bu xidmətlər tərtibatçıları infrastruktur idarəsindən azad edib modeli inkişaf etdirməyə yönəldir.

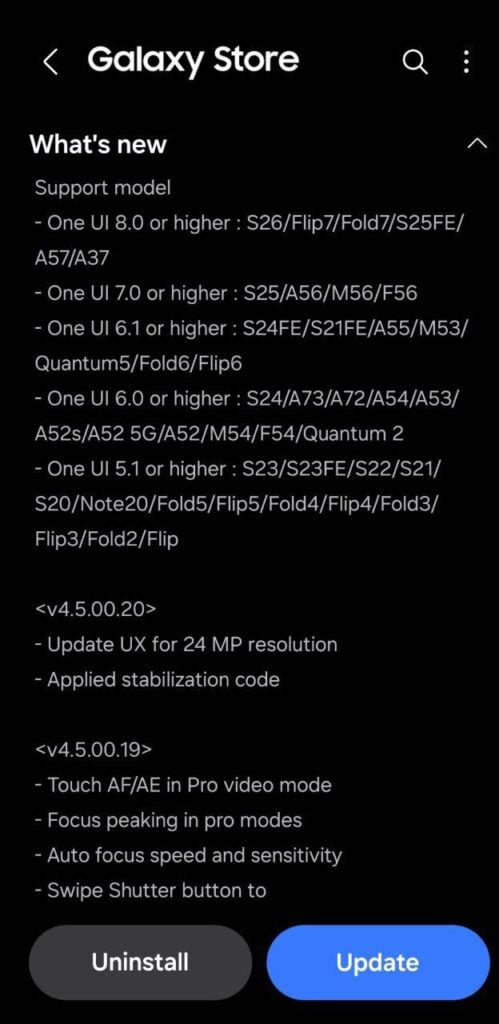

İncə tənzimləmə üçün isə müxtəlif seçimlər var: sadəlik üçün Cloud Batch, tam MLOps inteqrasiyası üçün Vertex AI Custom Training, konteynerləşdirilmiş mühit üçün GKE Autopilot. Axolotl kimi açıq mənbə çərçivələr isə prosesi daha da asanlaşdırır. Növbəti təqdimatın melanoma aşkarlanması üzrə 33 min görüntüdən ibarət real dataset üzərində praktiki nümayişlə davam edəcəyi bildirilmişdi.

Bu xəbəri necə dəyərləndirirsiniz?